Компания AMD объявила амбициозную цель — сделать масштабные AI-кластеры в дата-центрах в 20 раз энергоэффективнее к 2030 году. Это не просто слова, а продолжение долгой традиции Red Team по оптимизации производительности с минимальными затратами энергии.

AMD обещает революцию в энергоэффективности AI — уже к 2030 году

Пресс-релиз: В компании AMD вопрос энергоэффективности всегда стоял на первом месте при разработке продуктов и планировании стратегии. Более десяти лет мы ставим перед собой чёткие временные цели и постоянно превышаем их, делая свои процессоры и ускорители всё менее энергоёмкими при росте производительности. Сегодня с гордостью сообщаем — мы снова опередили самих себя и уже установили новую пятилетнюю планку в области энергоэффективности.

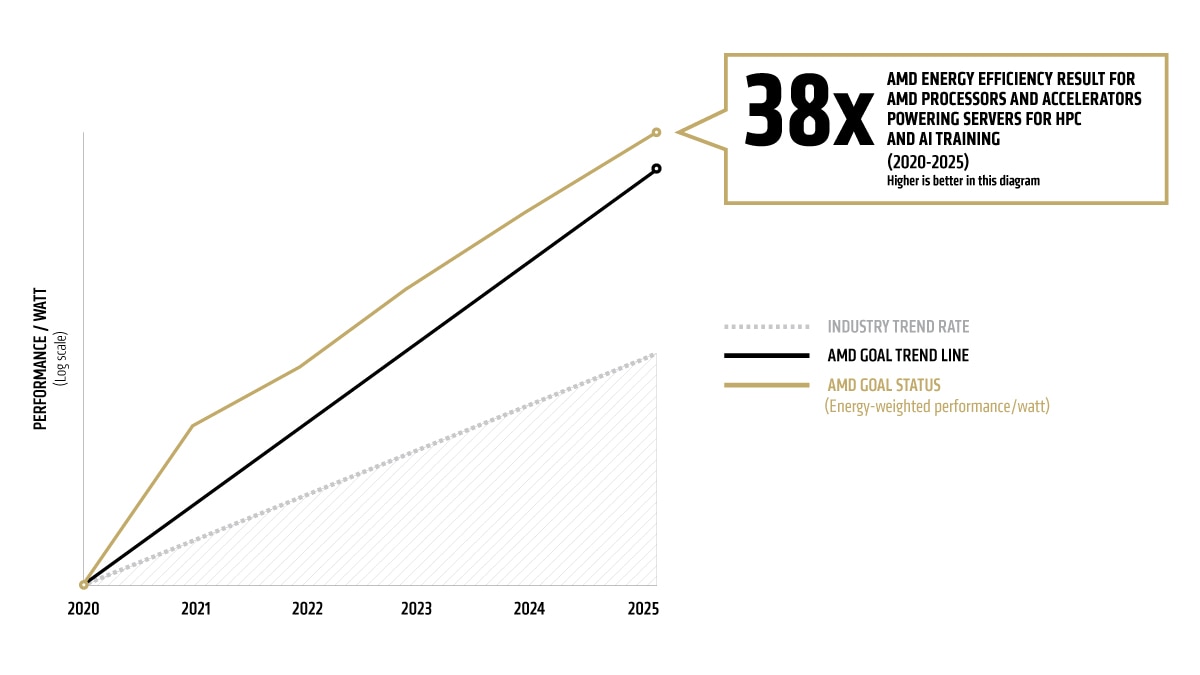

На конференции Advancing AI AMD рассказала, что уже превзошла свою цель «30×25», которую компания объявила в 2021 году. Напомню, суть цели — увеличить энергоэффективность вычислительных узлов для обучения AI и задач HPC (высокопроизводительные вычисления) в 30 раз к 2025 году по сравнению с уровнем 2020-го. Задача была крайне амбициозной, и AMD с гордостью заявляет — им удалось её перевыполнить. Но на этом остановка не планируется.

По мере того, как вычислительные нагрузки и масштаб AI-систем растут, важно смотреть шире — не только на отдельный процессор или ускоритель, а на всю инфраструктуру целиком. Поэтому AMD объявила новую, ещё более смелую цель — к 2030 году повысить энергоэффективность масштабируемых кластеров (то есть целых стоечных систем с процессорами, видеокартами, памятью и сетевыми компонентами) в 20 раз относительно 2024 года.

Почему важно повышать энергоэффективность именно для rack-систем?

Когда мы говорим об AI-вычислениях, важно понимать разницу между отдельным узлом и масштабом всего дата-центра. Увеличение энергоэффективности одной серверной карточки или CPU — безусловно важный шаг. Но ключ к действительно масштабируемым и устойчивым вычислениям — в оптимизации всей стойки (rack) целиком — сервера, подсистемы памяти, сетевого взаимодействия и совместной работы железа с программным обеспечением.

AMD прогнозирует, что её новая цель повысить энергоэффективность на уровне rack-систем к 2030 году будет в почти 3 раза выше среднего по индустрии темпа улучшений с 2018 по 2025 годы. Такие результаты станут возможны благодаря комплексному подходу, который включает в себя не только более быстрые и энергоэффективные CPU и GPU, но и инновации в области памяти, сетевых технологий, а также глубокой интеграции железа с софтом (hardware-software co-design).

Примечательно, что этим AMD ставит перед собой задачу, помогающую сделать работы дата-центров с искусственным интеллектом более устойчивыми и экологичными — в мире стремительно растущего спроса на AI-мощности это особенно актуально.

Что это даст в реальной жизни?

Рост энергоэффективности в 20 раз на уровне стоечных систем к 2030 году открывает ряд впечатляющих перспектив для операторов дата-центров и компаний, которые тренируют модели искусственного интеллекта:

- Консолидация оборудования: вместо 275 и более стоек можно будет использовать всего одну (полностью загруженную) стойку — это серьёзный выигрыш в занимаемой площади и сокращении аппаратных расходов.

- Снижение затрат на электроэнергию свыше 95% — притом при тех же или даже более высоких вычислительных возможностях.

- Уменьшение углеродного следа — выбросы углекислого газа при обучении одной AI-модели сократятся с примерно 3 000 до 100 метрических тонн CO2.

В России, где стоимость электроэнергии, особенно в крупных вычислительных центрах, является значительной статьёй расходов, такие улучшения могут кардинально изменить соотношение цена-качество и сделать собственные AI-разработки более выгодными. Особенно это важно для отечественных компаний, которые активно наращивают AI-потенциал в условиях растущей конкуренции.

Комментарий эксперта

По мнению ведущих инженеров и аналитиков отрасли, ставка AMD на энергоэффективность — это стратегический и своевременный ход. В отличие от простой гонки за абсолютной производительностью, которую в последние годы возглавляла Nvidia, AMD делает упор на баланс между мощностью и энергопотреблением.

Такой подход позволяет наращивать мощности дата-центров без пропорционального роста издержек и увеличения нагрузки на энергосистему. Особенно это будет ценным в условиях глобальной тенденции к экологической ответственности и устойчивому развитию.

Как показывает мировой опыт, операторы дата-центров и крупные IT-компании уже активно используют подобные показатели энергоэффективности для выбора оборудования и планирования своей инфраструктуры. В России с переходом на импортозамещение и активным развитием дата-хабов становится важным, чтобы поставщики учитывали и такие аспекты, как эффективность на уровне racks, а не только отдельных узлов.

Вывод

AMD по-прежнему держит марку одного из лидеров отрасли, демонстрируя, что революционные улучшения в энергоэффективности возможны и в эпоху масштабного развития искусственного интеллекта. Компания демонстрирует прагматичный взгляд на развитие вычислительных платформ — не только увеличивая их мощность, но и снижая затраты энергии и экологический след.

Для отечественных пользователей и бизнеса это также знаковый сигнал: будущее AI — это не только производительность, но и её устойчивость. Перспектива 20-кратного роста энергоэффективности к 2030 году может стать решающим фактором для построения эффективной и экологичной вычислительной инфраструктуры нового поколения.